Online make-up proberen, wijnaanbevelingen op basis van je voorkeuren, klantenservice die 24/7 actief is – chatbots zijn niet meer weg te denken van internet. Vanaf augustus 2026 moeten veel van dit soort AI-systemen voldoen aan de Artificial Intelligence Act van de Europese Unie (AI Act). Sommige verplichtingen gelden nu al. De AI Act is te groot om hier helemaal te behandelen, dus we focussen op een belangrijk deel voor e-commerce: waar krijg je juridisch mee te maken als je een chatbot inzet?

Tekst: Mirk Zwart

Voordat we een en ander uiteenzetten: test jezelf. Wat denk jij?

- Een webwinkel gebruikt een klantenservicechat met voorgeprogrammeerde vragen en antwoorden over bezorging en garantie. De klant klikt door totdat het juiste antwoord verschijnt. Is dit AI die onder de AI Act valt?

- Een virtuele winkelmedewerker op een kledingwebsite geeft persoonlijk koopadvies: je omschrijft je uiterlijk of uploadt een foto, en krijgt suggesties.Moet deze virtuele winkelmedewerker laten weten dat hij een AI is?

De antwoorden vind je in de tekst.

Waarom een AI Act?

Het doel van de AI Act is om AI in de EU betrouwbaar, veilig en mensgericht te maken. De wet stelt steeds strengere eisen naarmate de risico’s van het betreffende AI-systeem groter worden geacht. Dat is de risico-gebaseerde aanpak van de AI Act.

Wat verstaat de Act onder AI?

Een AI-systeem is een computersysteem dat zelfstandig werkt en zich kan aanpassen aan nieuwe situaties. Het systeem bepaalt zelf hoe het zijn doel bereikt door middel van inferentie - het vermogen om zelf uit informatie conclusies te trekken.

Het verschil met een ‘gewoon’ computerprogramma is dat AI niet alleen vooraf ingestelde instructies volgt (‘als A gebeurt, doe dan B’), maar zelf nieuwe oplossingen kan bedenken voor situaties die de maker niet had voorzien. Vergelijk het met een ervaren klantenservicemedewerker die creatieve oplossingen vindt voor onverwachte vragen, terwijl een beginnerscript alleen werkt met standaardantwoorden.

Neem een stofzuigrobot als voorbeeld. Een gewone robotstofzuiger volgt vaste regels: ‘Rij door tot je iets tegenkomt, draai dan om en onthoud je route.’ Een AI-stofzuiger gaat een stap verder: die leert zelf de slimste route te vinden en past zich aan aan jouw huis. Ook op manieren die niet door de programmeur zijn voorzien.

Een chatbot kan zo’n AI-systeem zijn. ChatGPT is daar een bekend voorbeeld van: stel je een vraag, dan bepaalt het systeem zelf hoe het antwoordt. Ook eenvoudigere systemen die op die manier werken, kunnen een AI-systeem zijn.

Het antwoord op vraag 1? De kern zit in 'voorgeprogrammeerd'. Als alle vragen en antwoorden vooraf zijn ingesteld, is het geen AI-systeem. Worden de antwoorden door het systeem zelf bedacht – op basis van de hierboven genoemde inferentie? Dan valt het onder de AI Act.

Wat houdt de risicogebaseerde aanpak in?

De regels verschillen per doel en toepassing van het AI-systeem. Sommige AI-praktijken zijn verboden (bijvoorbeeld manipulatieve toepassingen). Andere AI-systemen, zoals voor het beoordelen van sollicitaties of om leerlingen in de gaten te houden tijdens examens, zijn 'hoog risico' en moeten aan strenge eisen voldoen.

Een chatbot op je website zal niet snel verboden of hoog risico zijn, maar het kan wel, bijvoorbeeld als deze de gebruiker manipuleert (verboden) of als je deze inzet voor het beoordelen van cv’s op een ‘werken bij’-pagina (hoog risico). Bepalen in welke categorie een AI-systeem valt, kan complex zijn. Twijfel je of jouw AI-systeem verboden of hoog risico is? Schakel een jurist in.

Daarnaast zijn er AI-systemen met een transparantierisico: systemen waarbij mensen mogelijk niet doorhebben dat ze met AI te maken hebben. Hier gelden aparte regels voor.

Waar moeten chatbots aan voldoen?

Chatbots vallen hoe dan ook onder de systemen met een transparantierisico. Ze kunnen namelijk levensecht overkomen, dat botst met het mensgerichte karakter dat de AI Act vereist. Daarom moet het vanaf augustus 2026 voor een redelijk geïnformeerd gebruiker duidelijk zijn dat het om een AI-systeem gaat. Een simpele oplossing is om de chatbot te laten zeggen: ‘Hoi, ik ben geen mens!’ Maar andere passende manieren kunnen ook.

Het antwoord op vraag 2? Ja, de virtuele medewerker moet duidelijk maken dat het AI is. De manier waarop hangt af van je doelgroep – soms is de term 'virtuele medewerker' al duidelijk genoeg, soms moet het explicieter. Wanneer het voor een redelijk geïnformeerd persoon duidelijk is, is een afweging per AI-systeem.

Een andere belangrijke regel geldt al sinds februari 2025 voor álle AI-systemen: je personeel moet voldoende getraind zijn in het gebruik van AI-systemen (AI-geletterdheid). Wat voldoende is, hangt af van je AI-systeem en het type medewerkers dat er gebruik van maakt. Ook als je AI-chatbots inzet, moet je je personeel ‘AI leren lezen’; training en uitleg op maat dus.

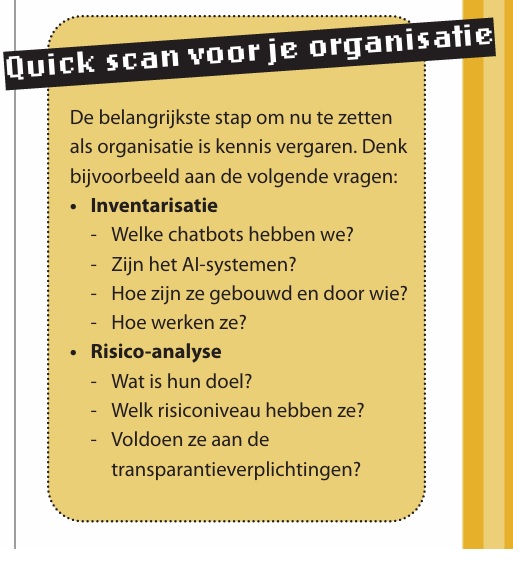

Voor de meeste chatbots zal de AI Act geen grote invloed hebben, mits ze goed gebouwd zijn en geen hoog risico met zich meebrengen. Check dit nu alvast om straks goed voorbereid te zijn.

Mirk Zwart is legal counsel bij ICTRecht. ICTRecht geeft in Twinkle juridisch advies omtrent e-commerce gerelateerde zaken.

Er is op dit moment 0 keer gereageerd op:

Legal Advice: AI Act

Je kunt niet meer reageren op dit artikel.